Il y a cinq ans, la question de laisser accéder les robots IA à ton site web n’existait pratiquement pas. Aujourd’hui, c’est une décision critique qui sépare les éditeurs réussis de ceux qui perdent du trafic et de la valeur d’entraînement. Les bots d’entraînement IA d’OpenAI, Anthropic, Google et d’autres demandent systématiquement l’accès à ton contenu, et beaucoup de propriétaires de sites web ne savent pas ce qui se passe – ou pire, n’ont pas de stratégie pour répondre. Les enjeux sont simples : autorise ton contenu à entraîner les modèles IA, et tu perds du trafic direct mais gagnes une exposition de marque dans les sorties IA. Refuse l’accès, et tu protèges ton trafic mais risques l’irrélevance alors que l’IA devient la source principale de découverte d’informations. Cet article explique la mécanique réelle du contrôle des robots IA, dissipe les mythes autour des restrictions robots.txt, et te montre comment construire une stratégie de gouvernance des données qui s’aligne avec tes objectifs commerciaux réels.

Les trois types de robots IA : ce avec quoi tu traites réellement

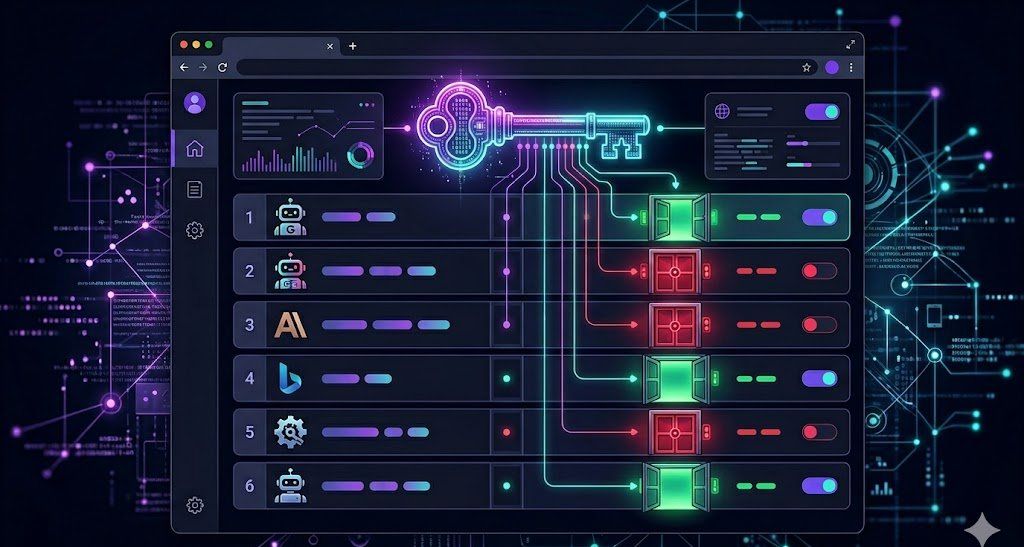

Avant de pouvoir contrôler les robots IA, tu dois comprendre ce que tu contrôles. Tous les bots IA ne sont pas créés égaux, et les regrouper sous « robots IA » obscurcit des distinctions critiques. Les bots d’entraînement téléchargent le contenu pour construire ou améliorer les modèles d’apprentissage automatique. Les bots de récupération récupèrent le contenu en temps réel pour alimenter les réponses des chatbots IA. Les bots d’indexation font les deux. GPTBot (OpenAI), Claude Web (Anthropic), et Bingbot-AI (Microsoft) sont des bots d’entraînement qui demandent la permission de scraper ton site pour l’entraînement du modèle. Google-Extended et Google-Web sont différents – Google a déjà ton contenu indexé, donc ces bots affinent la compréhension pour Gemini et l’Expérience Générative de Recherche. La distinction importe parce qu’un bot d’entraînement crée une extraction de valeur permanente (ton contenu entraîne un modèle de façon permanente), tandis qu’un bot de récupération crée un accès temporaire. Un éditeur qui bloqué GPTBot mais autorise Bingbot-AI fait un choix délibéré sur les écosystèmes IA qui obtiennent les données d’entraînement. C’est la gouvernance des données, pas la politique générale.

Pourquoi robots.txt seul n’est pas ta stratégie de gouvernance des données

Voici la vérité inconfortable : robots.txt est une demande, pas une loi. Quand tu ajoutes « Disallow: / » pour bloquer tous les robots, tu demandes poliment aux bots de partir. Les bots bien comportés respectent cela. Les bots malveillants et les simples scrapers non conformes l’ignorent complètement. La vraie idée fausse est que bloquer un robot IA dans robots.txt empêche son entraînement sur ton contenu. Ce n’est pas le cas. Un bot peut toujours télécharger ton site entier en ignorant simplement le fichier robots.txt. Ce que fait robots.txt, c’est signaler l’intention et filtrer les acteurs conformes. Bloquer GPTBot dans robots.txt arrête le robot officiel d’OpenAI qui respecte les règles, mais empêche pas OpenAI d’acheter ton contenu auprès des courtiers de données, de scraper via les services proxy, ou d’utiliser les versions en cache d’autres sites. Tu n’empêches pas l’accès ; tu refuses juste la demande polie. C’est pourquoi l’industrie de la sécurité pratique a migré vers robots.txt comme mécanisme de courtoisie plutôt que comme limite de sécurité. Une société de services financiers publiant des études de cas client sensibles ne peut pas s’appuyer sur robots.txt seul pour protéger ce contenu. Une startup SaaS publiant des recherches propriétaires sur les tarifs ne peut pas utiliser robots.txt comme sa seule défense. L’outil a été conçu en 1994 pour gérer les requêtes HTTP, pas pour appliquer la gouvernance des données à une époque où le contenu circule via les caches, les intégrations d’API, les agrégateurs de données, et les achats directs de base de données.

Exemple client : le dilemme SaaS – fuite de renseignements de tarification

TechFlow Solutions, une entreprise HR tech de marché intermédiaire avec 8 M USD de ARR, a publié un rapport de benchmark de 12 pages comparant son modèle de tarification avec cinq concurrents. Le rapport était porté derrière l’inscription par e-mail mais aussi partiellement publié sur leur blog pour le SEO – spécifiquement les sections sur la méthodologie de tarification et les structures de niveau entreprise. En trois mois, ils ont remarqué que sa structure de tarification apparaissait dans les réponses ChatGPT sur les solutions HR. Ils ont bloqué GPTBot dans robots.txt immédiatement, se sentant avoir sécurisé leurs actifs. Six mois plus tard, les réponses de Claude incluaient toujours leur tarification, textuellement, avec des descriptions de niveau spécifique qui n’ont jamais apparues dans des messages de blog publics. L’enquête a révélé qu’OpenAI avait obtenu le contenu de TechFlow via un canal différent : un agrégateur de données (spécialisé dans l’intelligence de tarification SaaS) qui scrapait déjà leur site avant la mise à jour robots.txt, et un site de comparaison tiers qui avait largement cité le rapport. Le blocage robots.txt était cérémoniel. Ce que TechFlow avait réellement besoin était des accords contractuels avec les distributeurs de données, des portes d’accès explicites d’opt-in pour les fonctionnalités alimentées par API, la limitation de débit sur ses points d’extrémité API de tarification, et des audits réguliers de là où son contenu était republié. Ils avaient aussi besoin de comprendre que les concurrents pourraient acheter ses données de tarification auprès des courtiers de données B2B spécialisés qui légalement acquièrent et redistribuent ces informations. C’est la différence entre la politique et la pratique. TechFlow a finalement négocié un accord de licence avec OpenAI où les données de tarification TechFlow pourraient être utilisées dans ChatGPT, mais seulement avec l’attribution appropriée et une clause de partage des revenus pour les comparaisons d’entreprise.

Cadre de décision stratégique : devrais-tu autoriser les robots IA ?

La vraie question n’est pas « Devrais-je bloquer les robots IA ? » mais plutôt « Quel est le moteur de valeur principal de mon contenu, et les robots IA l’améliorent-ils ou le sapent-ils ? » Pour une entreprise axée sur le contenu – un site d’actualités, un éditeur de recherche, une plateforme éducative – les robots IA représentent un changement fondamental dans la façon dont les lecteurs découvrent le contenu. Ton article pourrait maintenant apparaître comme citation de source dans une réponse Claude, ou comme données d’entraînement qui façonnent la façon dont ChatGPT discute de ton sujet. Certains éditeurs voient cela comme valeur de marque. D’autres le voient comme du cannibalisme de trafic. La réponse dépend de ton modèle commercial. Une marque de luxe publiant de la pensée leadership sur l’optimisation de la chaîne d’approvisionnement pourrait vouloir une large visibilité IA parce que l’objectif est l’autorité de marque, pas les revenus de clic. Cette entreprise devrait autoriser Google-Extended et peut-être ClaudeBot, mais pourrait bloquer les bots orientés consommateur comme ChatGPT (qui pourrait attribuer le contenu sans clic). Une entreprise de conseil financier publiant une analysé de risque pour les investisseurs accrédités pourrait bloquer tous les bots d’entraînement IA parce que la valeur de son contenu réside dans l’accès client exclusif, pas la découverte publique. Une SaaS de productivité publiant du contenu tutoriel pourrait autoriser tous les bots parce que l’objectif est le leadership de catégorie et le marketing entrant, pas les revenus de licence de contenu. Ce ne sont pas des réponses universelles. Ce sont des décisions stratégiques basées sur le fait que la valeur principale du contenu est le signal de marque, le trafic direct, l’accès exclusif, ou le positionnement de pensée leadership.

Exemple client : le choix de l’éditeur – stratégie IA du site d’actualités

CityNews Daily, une publication d’actualités régionale de taille moyenne, a fait face à une pression pour décider de l’accès IA. Son modèle de trafic est basé sur l’abonnement plus les revenus publicitaires sur les articles gratuits. Son analysé a montré que le trafic de recherche direct représentait 35% des abonnements, mais les résumés générés par IA de son reporting apparaissaient dans les bulletins d’information, les agrégateurs de nouvelles IA, et les chatbots sans attribution. En autorisant GPTBot, raisonnaient-ils, OpenAI accéderait au moins à leur site directement plutôt que par des sources secondaires. Ils pourraient demander l’attribution appropriée dans les conditions d’OpenAI. CityNews a autorisé GPTBot mais bloqué Bingbot-AI et Google-Extended, raisonnant que les robots de Microsoft et Google concurrenceraient directement leurs classements de recherche. Le résultat : leurs histoires apparaissent maintenant dans ChatGPT avec les bonnes signatures et les bons liens. Leur trafic des références ChatGPT a augmenté de 22% au premier trimestre parce que les gens cliquaient pour vérifier les détails ou lire les articles complets. Leurs classements de recherche n’ont pas souffert parce qu’ils ne concurrençaient pas avec Bingbot ou Google-Extended. La décision stratégique n’était pas d’autoriser « les robots IA » – c’était d’autoriser le bot spécifique qui enverrait du trafic d’attribution tout en bloquant les robots concurrents qui cannibaliseraient la visibilité de recherche.

Exemple client : renseignement stratégique de cabinet de conseil

Entreprise de cabinet de conseil de style McKinsey StrategyCore publie des rapports de pensée leadership sur la transformation d’entreprise, la stratégie numérique, et le changement organisationnel. Leur modèle commercial est les engagements de conseil premium où la recherche informe les projets de transformation multi-millions de dollars. Ils ont découvert que leur cadre propriétaire pour évaluer la maturité numérique – qu’ils avaient publié dans un livre blanc – était utilisé dans des outils IA concurrents qui conseillaient les clients sur la transformation. Bloquer tous les bots IA semblait raisonnable, mais ils ont réalisé que les clients eux-mêmes collaient le contenu de StrategyCore dans ChatGPT pour obtenir des perspectives alternatives et une vérification. Bloquer les bots ne pouvait pas prévenir cela. À la place, StrategyCore a implémenté une stratégie différente : ils ont autorisé tous les bots IA (raisonnant que plus les systèmes IA comprennent leur méthodologie, plus les clients sophistiqués auraient besoin de leur expertise en implémentation), mais ils ont publié leurs cadres stratégiques les plus propriétaires dans des sections authentification requise du site. Ces sections portées étaient marquées dans robots.txt comme Disallow, et ils ont ajouté le langage contractuel aux accords du portail client interdisant l’usage concurrentiel de leurs méthodologies. Cela a créé un modèle de gouvernance à niveaux : la pensée leadership gratuite est disponible aux robots IA et au public (pour la visibilité de marque), tandis que les implémentations propriétaires nécessitent l’engagement client direct. Le résultat est que les systèmes IA citent StrategyCore comme une autorité sur la stratégie de transformation, ce qui entraîne les clients entrants des entreprises explorant la transformation numérique.

La méthode User-Agent : contrôle granulaire via robots.txt

Si tu décides que ta stratégie implique l’accès bot sélectif, robots.txt est le bon outil pour exprimer cette préférence, même si ce n’est pas une limite de sécurité. La directive User-Agent te permet de définir des règles différentes pour les bots différents. Une approche basique : autoriser les bots Google, autoriser le GPTBot d’OpenAI, bloquer Bingbot et Claude Web. Cette approche envoie un signal clair aux acteurs conformes sur ta préférence sans prétendre que c’est un mécanisme de sécurité. Voici ce que cela ressemble en pratique : User-Agent: GPTBot, Allow: / dit à OpenAI que tu accueilles leur bot d’entraînement. User-Agent: CCBot, ClaudeBot, Disallow: / dit à Anthropic d’utiliser une autre source. User-Agent: bingbot, Disallow: / dit à Microsoft de reculer. User-Agent: * Disallow: s’applique à tous les autres. Cette granularité te permet de faire un choix délibéré sur les relations d’entraînement IA que tu veux encourager. Les bots conformes la respecteront. L’important est de ne pas prétendre que c’est de la sécurité ; c’est d’exprimer ta préférence clairement et de documenter ton raisonnement en interne.

Exemple client : protection du catalogue e-commerce

DesignMart, un détaillant de meubles en ligne, publie des descriptions de produits, des guides de conception intérieure et des catalogues de tarification. Leur avantage concurrentiel réside dans la curation de produits et la photographie unique de produits. Ils ont découvert que ses descriptions et images étaient utilisées dans un assistant d’achat IA concurrent qui alimentait la fonction de recherche d’un autre détaillant. Bloquer les robots dans robots.txt n’aurait pas arrêté le concurrent d’acheter les données auprès d’un service de scraping. À la place, DesignMart a implémenté une stratégie en trois parties : ils ont autorisé les bots Google (pour la visibilité de recherche), bloqué tous les bots d’entraînement IA via robots.txt (comme signal de préférence), et ajouté des conditions contractuelles à leur API de données de produits qui interdisaient explicitement l’utilisation de l’entraînement IA. Pour le contenu qu’ils voulaient distribuer – comme les guides de conception – ils ont utilisé une licence Creative Commons qui interdisait explicitement l’entraînement commercial du modèle IA. Pour le contenu propriétaire du catalogue, ils ont appliqué des exigences de connexion et l’authentification API. Cette approche mixte a reconnu que robots.txt seul était insuffisant mais que la combinaison de la politique, des conditions contractuelles et des contrôles d’accès technique créait une position défendable.

Exemple client : gouvernance des données de l’éditeur académique

ScholarHub, un éditeur de recherche universitaire, publie des documents évalués par des pairs et des ensembles de données de recherche. Ils ont fait face à un défi spécifique : permettre aux robots IA de s’entraîner sur leur recherche publiée pourrait faire avancer le progrès scientifique (une mission déclarée), mais cela signifierait aussi que leurs articles seraient résumés dans ChatGPT sans que les lecteurs cliquent sur l’article complet. Leur solution était l’accès sélectif : ils ont autorisé Google-Extended (pour améliorer les résultats Scholar), autorisé ClaudeBot (pour soutenir le progrès de la recherche IA), mais bloqué Bingbot-AI (pour éviter la concurrence avec Bing Scholar). Ils ont également exigé que tout modèle IA utilisant leur contenu fournisse des citations de source directs et inclure un lien vers l’article original. Ce n’était pas applicable par robots.txt seul, mais ils l’ont incorporé dans leurs conditions API et leur licence ouverte. L’aperçu clé : ils n’essayaient pas de prévenir l’accès IA entièrement (ce qui contredisait leur mission), mais plutôt de le canaliser d’une manière qui s’alignait avec les valeurs académiques – accès ouvert à la recherche, attribution appropriée, et soutien au progrès de la recherche.

Approches légales et contractuelles : au-delà de robots.txt

Si ton contenu a une valeur économique significative – recherche propriétaire, données client exclusives, renseignement compétitif – robots.txt seul ne suffit pas comme gouvernance. Tu as besoin de cadres contractuels et légaux. Les conditions de service qui interdisent explicitement l’exploration de données et l’entraînement du modèle IA. Les accords API qui incluent des clauses exigeant le consentement d’opt-in pour l’entraînement du modèle. L’application du droit d’auteur qui envoie des avis de suppression quand ton contenu est utilisé sans permission. Les accords de licence qui spécifient l’usage commercial vs. non-commercial, entraînement vs. récupération, exigences d’attribution. Ces outils ne concernent pas le blocage des robots ; ils concernent l’établissement de limites légales et de conséquences pour violation. Une entreprise d’analysé de données publiant des rapports de recherche peut utiliser la loi sur le droit d’auteur pour appliquer que les rapports sont autorisés pour la lecture uniquement, pas pour l’entraînement des modèles IA. Une entreprise de conseil peut exiger l’authentification API et enregistrer tout accès, créant une piste d’audit de qui a accédé à quoi. Une entreprise de médias peut utiliser robots.txt pour signaler la préférence mais s’appuyer sur les licences de droit d’auteur pour appliquer réellement les restrictions. L’important est que la gouvernance des données est une pile de technologies et de politiques, pas un outil unique. robots.txt est le premier signal poli. Les accords légaux sont la couche d’application.

Exemple client : sensibilité concurrentielle B2B SaaS

DataStack Pro, une plateforme de business intelligence, publie des benchmarks de l’industrie – des données sur la façon dont les entreprises dépensent en infrastructure d’analysé, les outils qu’elles adoptent, les délais de migration. Ces données sont extrêmement précieuses pour les concurrents et pour les entreprises d’investissement analysant le marché. DataStack a bloqué tous les bots d’entraînement IA via robots.txt mais a réalisé que ce n’était pas suffisant pour la protection : les concurrents pourraient acheter les données auprès des services de recherche de l’industrie qui les avaient déjà archivés. Ils ont implémenté une approche plus sophistiquée : ils ont publié une version publique de leurs benchmarks (avec robots.txt bloquant les bots IA comme signal), mais mis en porte un accès la version détaillée derrière une connexion qui exigeait la vérification de la société. Ils ont ajouté le langage contractuel à leurs licences de données détaillées déclarant que l’utilisation des données pour entraîner les modèles concurrents était interdite. Quand ils ont découvert un concurrent utilisant leurs données de benchmark dans un modèle concurrent, ils ont envoyé une lettre de cessation et d’abstention citant à la fois la violation de licence et la possible violation du droit d’auteur. Le blocage robots.txt seul ne faisait rien, mais combiné avec des portes d’accès de connexion, des conditions contractuelles et des mesures d’exécution, il a créé une position défendable qui importait réellement.

Exemple client : protection des droits des créateurs de contenu

Creative Voices, une plateforme pour les écrivains et artistes indépendants, a fait face à un défi unique : leurs utilisateurs étaient des créateurs individuels qui voulaient contrôler si leur travail entraînait les modèles IA. CreativeVoices ne pouvait pas prendre une décision universelle pour tous les créateurs. À la place, ils ont implémenté l’opt-in par créateur. Chaque créateur pouvait choisir : autoriser GPTBot, autoriser ClaudeBot, bloquer tous les bots d’entraînement IA, ou personnaliser leurs propres règles. CreativeVoices a mis à jour le fichier robots.txt de chaque créateur dynamiquement en fonction de leurs préférences. Ils ont aussi construit un cadre de « licence d’entraînement de modèle » où les créateurs pourraient spécifier si leur travail pouvait être utilisé pour l’entraînement IA, et à quel niveau de compensation. Certains créateurs ont choisi d’autoriser l’entraînement pour une part des revenus (un modèle qui a émergé avec des services comme Spawning.ai), tandis que d’autres ont choisi de bloquer complètement. La gouvernance ici était dirigée par le créateur, pas par la plateforme. Cette approche a reconnu que la gouvernance du contenu n’est pas une décision – c’est plusieurs décisions prises par les propriétaires de contenu réels, avec les plateformes fournissant les outils pour exprimer ces décisions.

Idées fausses courantes sur le contrôle des robots IA

Idée fausse 1 : « Bloquer un bot dans robots.txt empêche mon contenu d’être accédé. » Faux. Un bot peut ignorer robots.txt complètement. Bloquer dans robots.txt envoie un signal de préférence aux acteurs conformes, rien de plus. Idée fausse 2 : « Si je bloqué tous les bots, mon contenu n’entraînera pas les modèles IA. » Faux. Les bots peuvent scraper via les proxies, accéder aux versions en cache, ou être entraînés sur ton contenu via des sources secondaires (agrégateurs, concurrents, archives). Bloquer les bots empêche la demande directe, pas l’entraînement. Idée fausse 3 : « Les bots d’entraînement IA nuiront à mon classement de recherche. » Partiellement faux. Google-Extended et Bingbot-AI sont différents des bots d’entraînement. Ils affinent les algorithmes de classement plutôt que de les remplacer. Cependant, les résumés ChatGPT pourraient cannibaliser le trafic s’ils répondent aux questions suffisamment bien pour prévenir le clic. C’est un risque de cannibalisme de trafic, pas un risque de classement. Idée fausse 4 : « robots.txt est une protection légale pour mon droit d’auteur. » Faux. robots.txt n’a pas de statut légal. La protection du droit d’auteur vient de la loi sur le droit d’auteur, des accords de licence, et de l’exécution. Idée fausse 5 : « Tous les robots IA sont les mêmes. » Faux. Les bots d’entraînement, les bots de récupération et les bots d’indexation servent des objectifs différents. Ta stratégie doit refléter quels bots servent ton modèle commercial et lesquels ne le font pas.

Exemple client : négociation de licence médias

PhotoWire, une agence indépendante de photojournalisme, publie des milliers d’images sous licence. Ils ont découvert que leurs images apparaissaient dans les recommandations de photos générées par IA et les outils de légende d’image sans accords de licence. Ils ont pris une approche axée sur la licence : ils ont bloqué tous les bots d’entraînement IA dans robots.txt (comme signal de préférence), mais plus importante, ils ont approché directement les constructeurs de modèles IA. Ils ont négocié des accords de licence avec Anthropic et OpenAI pour permettre l’usage limité de leurs images pour l’entraînement du modèle, en échange d’attribution dans les légendes générées et le partage des revenus sur les applications commerciales. Pour les bots qui n’avaient pas négocié avec eux, le blocage robots.txt a renforcé leur préférence. Pour les bots qui avaient signé des accords, le blocage robots.txt a été levé. Cette approche a changé le script : au lieu de simplement se défendre contre les robots, PhotoWire a transformé l’entraînement du modèle IA en canal commercial. Ils gagnent maintenant des revenus de licence de l’entraînement du modèle IA, ce qui n’existait pas il y a cinq ans.

Construire ton cadre de gouvernance des données : une liste de contrôle pratique

D’abord, définis la valeur principale de ton contenu. Est-ce un signal de marque, un trafic direct, un accès exclusif, ou une pensée leadership ? Cela détermine si tu veux la visibilité IA ou non. Deuxièmement, audite où ton contenu est actuellement utilisé. Recherche ton contenu dans ChatGPT, Claude, et Bing Chat. Trace les agrégateurs et les sources secondaires. Troisièmement, décide ta stratégie bot en utilisant la méthode User-Agent dans robots.txt. Quels bots s’alignent avec la valeur de ton contenu ? Autorise-les explicitement, bloqué les autres. Fais cette décision intentionnelle, pas réactive. Quatrièmement, établis des limites contractuelles. Si ton contenu a une valeur économique, ajouté des restrictions d’usage des données à tes conditions API, licences, et accords utilisateur. Rends clair que l’entraînement du modèle IA nécessite la permission explicite. Cinquièmement, considère l’exécution légale. Si tu es sérieux sur la gouvernance des données, sois préparé à envoyer des avis de suppression, émettre des lettres de cessation et d’abstention, ou poursuivre les accords de licence. Sixièmement, surveille la conformité. Vérifie régulièrement où ton contenu apparaît dans les modèles IA. Configure les Alertes Google, utilise la recherche d’images inversée pour le contenu visuel, et interroge régulièrement ChatGPT sur tes sujets. Septièmement, documente ton raisonnement. Conserve des dossiers internes de pourquoi tu as pris chaque décision. Cela te protège si tu fais face à des défis légaux et t’aide à affiner ta stratégie au fil du temps.

L’avenir de la gouvernance des données IA : vers les modèles de compensation

L’état actuel de l’accès aux robots IA est en transition. robots.txt et l’exécution légale sont des palliatifs. La tendance à long terme pointe vers des modèles de compensation où les créateurs de contenu sont payés pour la valeur que leur contenu fournit à l’entraînement du modèle IA. Les éditeurs négocient déjà des accords de licence avec les constructeurs de modèles. Les créateurs individuels rejoignent des plateformes de partage de compensation. Les organisations d’actualités forment des consortiums pour négocier collectivement avec les entreprises IA. Finalement, l’économie de l’entraînement IA exigera une compensation – les modèles seront tellement précieux que payer les créateurs deviendra routine, et robots.txt deviendra obsolète. Cette transition est déjà en cours. Jusque-là, la gouvernance des données est ta responsabilité. Tu dois décider quel accès tu accordes, appliquer ces décisions par la politique et le contrat, et surveiller où ton contenu finit. Ce n’est pas à propos de bloquer les robots IA entièrement ; c’est à propos de faire des choix délibérés alignés avec tes objectifs commerciaux.

La décision stratégique concernant l’accès aux robots IA n’est pas un choix unique. C’est un cadre pour la prise de décision qui évolue avec ton entreprise, la proposition de valeur de ton contenu, et l’économie plus large de l’entraînement IA. Revisite cette décision tous les six mois. Surveille où ton contenu apparaît dans les systèmes IA. Traque les nouveaux bots et les nouvelles entreprises IA. Ajuste tes règles robots.txt et tes limites contractuelles alors que le paysage se déplace. Les éditeurs et créateurs qui prospéreront dans un environnement d’information axé sur l’IA ne sont pas ceux qui paniquent et bloquent tout. Ce sont ceux qui comprennent la valeur de leur contenu, font des choix délibérés sur l’accès, appliquent ces choix clairement, et se positionnent pour capturer la valeur de la transition vers la découverte alimentée par l’IA. Ton fichier robots.txt est un signal dans une stratégie complète. Utilise-le, mais ne te fies pas à lui seul.