Google Search Console (GSC) est l’outil gratuit le plus essentiel pour les professionnels du SEO et les propriétaires de sites web. Contrairement à Google Analytics, qui te montre ce que les visiteurs font sur ton site après leur arrivée, GSC te révèle ce que Google voit avant même que ton site n’apparaisse dans les résultats de recherche. Il t’indique comment ton contenu est indexé, quels mots-clés Google associe à tes pages, à quelle fréquence ton site apparaît dans les résultats de recherche, et quels problèmes techniques empêchent l’indexation. Beaucoup de sites laissent un énorme potentiel inexploité dans GSC parce qu’ils ne le consultent que lorsque des problèmes surviennent—utilisant essentiellement une Ferrari comme un camion de pompiers. Au lieu de cela, GSC devrait être ton outil de monitoring principal chaque semaine—aux côtés de ta plateforme d’analytics. La différence entre les sites web qui utilisent GSC stratégiquement et ceux qui ne le font pas est substantielle : les utilisateurs stratégiques rétablissent des centaines de milliers de dollars de trafic et de conversions perdus que les concurrents manquent entièrement. Ce n’est pas une exagération—c’est une estimation conservatrice basée sur de vrais cas que nous avons rencontrés où un seul aperçu GSC a mené au doublement du trafic organique en quelques mois.

Pourquoi Google Search Console est plus importante que la plupart des gens ne le réalisent

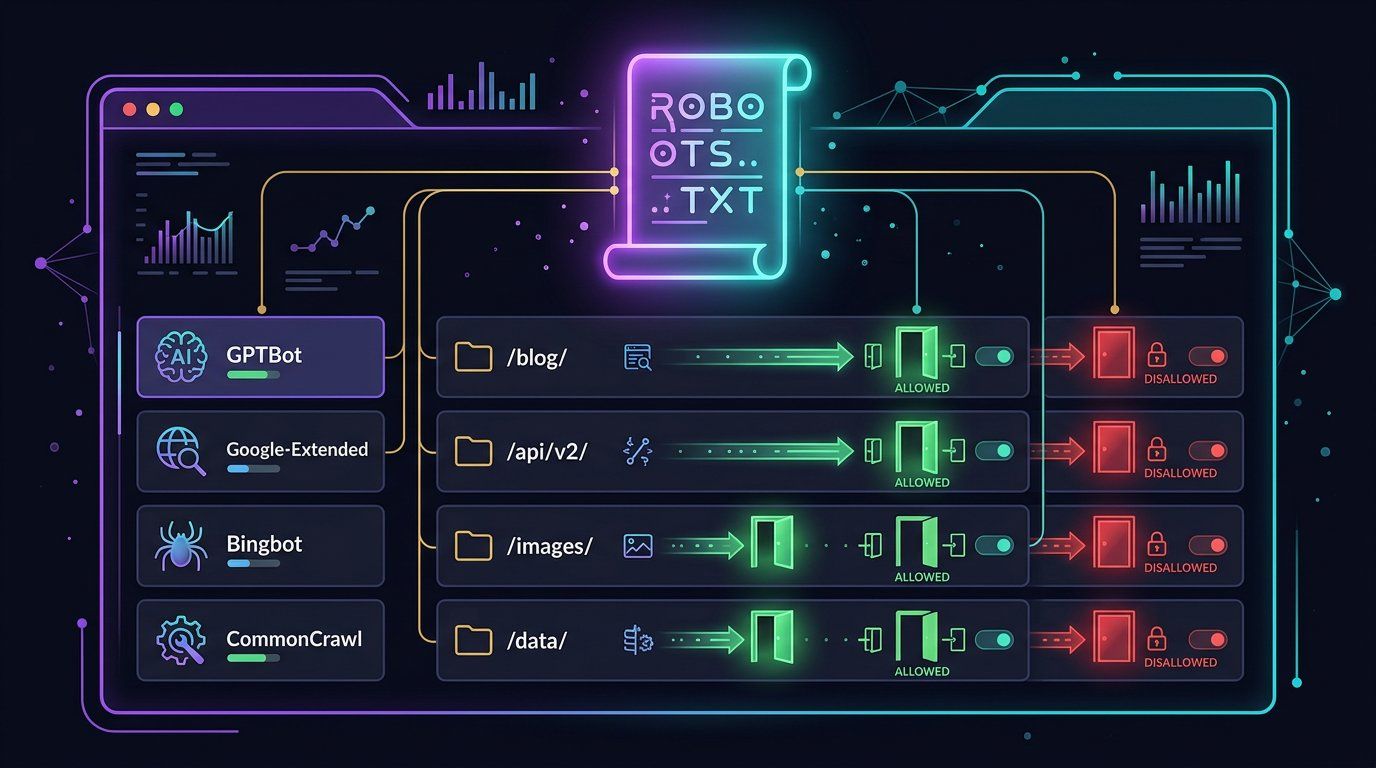

De nombreux praticiens du SEO traitent GSC comme un outil de dépannage plutôt que comme un atout stratégique. C’est une erreur importante. GSC est l’endroit où Google te dit littéralement quelles pages il connaît, lesquelles il peut explorer, et lesquelles ont des problèmes. Par exemple, une entreprise de logiciels B2B a découvert via GSC que 40% des URL de ses articles de blog étaient bloquées par son fichier robots.txt en raison d’une règle de redirection mal configurée. Corriger ce seul problème a doublé le nombre de pages indexées en deux semaines. Un autre exemple : un site de commerce électronique a découvert que Google ne pouvait pas explorer les variations de ses pages de produits en raison d’un problème de gestion des paramètres dans sa structure d’URL. Le rapport de couverture d’index de GSC a identifié le problème exact en quelques minutes—ce qui aurait pris des semaines à diagnostiquer avec d’autres outils ou une investigation manuelle. Cette clarté immédiate est ce qui rend GSC inestimable. Sans GSC, tu essentiellement débogues ton SEO dans le noir.

Sans GSC, tu navigues à l’aveugle. Tu ne sais pas si Google découvre ton contenu, pourquoi il n’est pas indexé, ou si ton site a des problèmes techniques d’exploration. Une agence de marketing de contenu avec laquelle nous avons travaillé ne voyait pas la croissance du trafic organique malgré la publication de contenu de haute qualité. GSC a révélé que le schéma de fil d’Ariane de son site était cassé, ce qui a dérouté Google sur la hiérarchie de son contenu. Une fois réparé, leur position SERP moyenne s’est améliorée de 2,5 places pour leurs mots-clés cibles. GSC te dit aussi quelque chose que Google Analytics ne peut pas : les vraies impressions de mots-clés et les taux de clic directement du point de vue de Google. Ces données ne sont pas filtrées par les préoccupations de confidentialité et représentent le comportement de recherche réel—pas échantillonné, pas estimé, mais les données réelles des serveurs de Google. Chaque requête pour laquelle Google a montré ton site est comptée dans le rapport de performance de GSC. Ceci est la vérité de base de ta visibilité de recherche organique, et c’est une donnée qu’aucun outil tiers ne peut répliquer avec une précision parfaite.

Configurer Google Search Console : la bonne façon

Configurer correctement GSC dès le départ prévient les mois de données manquantes et s’assure que tu captures tout. D’abord, tu dois vérifier la propriété de ton domaine. Google propose plusieurs méthodes de vérification : upload de fichier HTML, enregistrement DNS, insertion de balise HTML, vérification Google Analytics, ou vérification Google Tag Manager. Pour la plupart des sites web, la méthode DNS est la plus fiable car elle est permanente et ne dépend pas des uploads de fichiers ou des balises présentes. Une entreprise fintech que nous avons conseillée a d’abord essayé la méthode de balise HTML, mais ses gestionnaires de balises l’ont accidentellement supprimée lors d’une migration de plateforme, cassant sa vérification GSC. Le passage à la vérification DNS a résolu ce problème définitivement. La méthode DNS crée un enregistrement permanent sur ton registraire de domaine que Google vérifie périodiquement. Cette approche est supérieure pour les entreprises et toute organisation qui se déplace fréquemment entre les plates-formes. La vérification DNS survit aussi aux migrations de serveurs, aux changements d’hébergement, et aux mises à jour de thème sans interruption.

Après la vérification, ajouté à la fois les versions www et non-www de ton domaine en tant que propriétés séparées si tu les utilises toutes les deux en production. Beaucoup de sites en redirigent une vers l’autre, mais Google en explore toujours occasionnellement les deux. Une propriété est séparée—tu dois vérifier chacune individuellement. Ensuite, télécharge ton sitemap XML. Cela indique à Google où se trouvent toutes tes pages de contenu et aide à la découverte. Si tu as plusieurs sitemaps (un pour les articles de blog, un pour les pages de produits, un pour les actualités, etc.), tu peux les soumettre tous. Une entreprise d’édition avec laquelle nous avons travaillé avait trois sitemaps pour différents types de contenu, et soumettre tous les a réduit le temps nécessaire pour que de nouveaux articles soient indexés de 10 jours à 3 jours en moyenne. Google utilise les sitemaps comme indice de priorité d’exploration—les pages dans les sitemaps sont explorées plus fréquemment que celles non incluses. Les sitemaps sont particulièrement importants pour les grands sites avec des milliers de pages, et ils sont critiques pour les sites de commerce électronique où le catalogue de produits change fréquemment.

Comprendre le rapport de performance

Le rapport de performance est le cœur de GSC. Il te montre quatre indicateurs clés : le nombre total de clics, les impressions, le taux de clic moyen (CTR), et la position moyenne. Clarifions ce que ces termes signifient car de nombreuses personnes les comprennent mal fondamentalement. Les impressions sont le nombre de fois que ton URL a été affichée dans les résultats de Google Search pour une requête de recherche—cela inclut la position 1 à travers 100 et au-delà. Les clics sont les visites réelles sur ton site depuis Google Search. Le CTR est les clics divisés par les impressions : si ta page a obtenu 1 000 impressions et 50 clics, ton CTR est de 5%. La position moyenne est celle où ta page s’est classée en moyenne pour toutes les requêtes qui l’ont associée. Un site web de soins de santé que nous avons analysé avait 50 000 impressions mensuelles mais seulement 2 500 clics—un CTR de 5%. Ils pensaient que c’était normal. Après avoir analysé les données, nous avons découvert que les pages avec une position moyenne de 5-8 avaient un CTR de 3%, tandis que les pages en position 1-2 avaient un CTR de 15%. Cela a révélé que leur vrai problème n’était pas les classements pour les requêtes non liées—c’était que certains mots-clés de haute valeur n’étaient pas du tout découverts. La position compte plus que la plupart des gens ne le réalisent, et la mesure CTR t’aide à comprendre la qualité du classement.

Utilise les filtres du rapport de performance pour identifier le contenu sous-performant. Trie par clics pour trouver tes gagnants en matière de trafic. Ensuite, regarde les mots-clés en basse position—les requêtes où ta page se classe en position 11-50 mais obtient zéro clics. Ce sont des opportunités en or car tu es déjà visible mais pas assez compétitif dans l’extrait ou le titre pour attirer les clics. Une entreprise SaaS a utilisé cette technique pour découvrir qu’elle se classait pour « outils de gestion de projet » en position 14. En optimisant sa balise de titre et sa méta description pour cette requête, elle s’est déplacée à la position 3 en 4 semaines et a capturé 1 200 clics mensuels supplémentaires. C’est un pur levier SEO—tu ne concours pas pour la visibilité, juste en améliorant la compétitivité dans ta visibilité existante. Tu peux aussi filtrer par plage de dates, requête, page, type d’appareil, et pays. Une entreprise locale a découvert en filtrant par pays qu’elle recevait un trafic de recherche important de régions géographiques non prévues. En ciblant plus spécifiquement leurs mots-clés locaux, ils ont réduit les impressions gaspillées et amélioré significativement leurs classements locaux. Cette capacité de filtrage est puissante—la plupart des concurrents ne l’utilisent jamais, ce qui signifie que tu gagnes un avantage immédiat simplement en étant minutieux.

Couverture d’index : trouver les problèmes d’exploration cachés

Le rapport de couverture d’index te montre exactement quelles pages de ton site Google a indexées et lesquelles il n’a pas. Il se divise en quatre catégories : pages valides (indexées et fonctionnant correctement), valides avec avertissements (indexées mais avec des problèmes), exclues par toi (tu as dit à Google de ne pas les indexer via robots.txt ou balises noindex), et erreurs (Google a essayé d’explorer mais a échoué). De nombreux propriétaires de sites paniquent quand ils voient un grand nombre « exclus », mais c’est souvent intentionnel. Un site corporate a exclu la totalité de sa page de résultats de recherche interne, les pages d’archive des balises, et les variations de paramètres en double—ce qui est exactement ce qu’ils devraient faire. Le vrai problème se trouve dans la catégorie « erreurs ». Si Google dit que tes pages ont des erreurs d’exploration, tu dois savoir pourquoi. Les causes communes incluent les erreurs serveur 404, les chaînes de redirection, les problèmes de délai d’expiration du serveur, les problèmes de certificat SSL, et les ressources bloquées (CSS, JavaScript, images bloquées par robots.txt). Les erreurs représentent une opportunité d’indexation perdue qui se compose exponentiellement au fil du temps.

Un vrai exemple : une plateforme de commerce électronique que nous avons auditée avait 15 000 pages bloquées de l’indexation en raison de chaînes de redirection. Sa structure d’URL a redirigé les pages de produits à travers trois règles de redirection différentes avant d’atteindre l’URL canonique finale. Google a abandonné après avoir suivi la chaîne, marquant ces URL comme des erreurs. Nous avons restructuré leurs redirections pour être directes, et dans un cycle d’exploration suivant, ces 15 000 pages ont été indexées. Un autre cas : un site d’actualités avait des avertissements de certificat SSL causant à Google d’explorer mais de ne pas indexer certaines pages. L’installation d’un certificat valide a résolu le problème en quelques jours. Enquête toujours sur les « erreurs » et « avertissements » immédiatement—ils te disent que Google ne peut pas indexer ton contenu. Ne les ignore pas en espérant qu’ils disparaîtront ; ils ne disparaîtront pas. Chaque erreur représente une perte de trafic potentielle. Ces problèmes s’aggravent avec le temps, et un site web qui a été cassé pendant six mois a perdu six mois de croissance organique. Quand tu trouves des erreurs, priorise leur correction par rapport à presque tous les autres travaux d’optimisation.

Core Web Vitals : comprendre le signal d’expérience de page de Google

Les Core Web Vitals mesurent l’expérience utilisateur sur tes pages. Google les considère comme un facteur de classement—pas le plus important, mais un vrai signal de classement. GSC te montre les données des Core Web Vitals ventilées par appareil (mobile, ordinateur de bureau, tablette) et catégorise les pages comme bonnes, nécessitant une amélioration, ou mauvaises. Les trois Core Web Vitals sont : Largest Contentful Paint (LCP)—la vitesse à laquelle le plus grand élément visuel de ta page se charge, Cumulative Layout Shift (CLS)—à quel point la mise en page de ta page se décale lors du chargement, et First Input Delay (FID)—la rapidité avec laquelle ta page répond à l’interaction de l’utilisateur. Un site de commerce électronique de mode avec lequel nous avons travaillé avait de mauvaises scores LCP mobiles (au-dessus de 4 secondes) parce que leur image en vedette n’était pas optimisée. La compression de l’image et l’ajout du chargement paresseux ont amélioré LCP à 1,8 secondes, et dans 6 semaines leur trafic mobile a augmenté de 18%. Ce n’était pas un coup de classement direct—c’était l’amélioration de l’expérience utilisateur menant à un meilleur taux de clic depuis les résultats de recherche et des taux de rebond plus faibles. Les métriques d’expérience utilisateur impactent à la fois les classements et les conversions directement.

De nombreux sites pensent que les Core Web Vitals sont purement techniques. Ce n’est pas le cas. Une entreprise de logiciels B2B avait une bonne LCP et CLS mais une mauvaise FID sur ordinateur de bureau parce que sa validation de formulaire JavaScript était lourde. Le report de l’exécution des scripts non critiques a réduit FID de 250ms à 45ms. L’amélioration n’a pas montré un saut de classement immédiat, mais leur taux de conversion de formulaire s’est amélioré de 12% car les utilisateurs ne ressentaient pas de délais lors de l’interaction avec le formulaire. Lors de l’analysé de tes Core Web Vitals dans GSC, regarde à la fois les URL problématiques et les URL performantes—vois ce qu’elles ont en commun. Une entreprise technologique a découvert que ses pages utilisant une bibliothèque JavaScript particulière avaient de pires scores LCP. Le remplacement de cette bibliothèque a amélioré les métriques de l’ensemble de son site. Les Core Web Vitals sont à la fois un facteur de classement et une mesure de satisfaction utilisateur. Ils correspondent directement aux résultats commerciaux. Quand tu améliores les Core Web Vitals, tu investis à la fois dans le SEO et dans l’optimisation du taux de conversion simultanément.

Liens et suivi des backlinks

Le rapport des liens de GSC te montre les backlinks pointant vers ton site. Il affiche les sites les plus liant, les pages les plus liées sur ton site, et le texte d’ancrage utilisé dans ces liens. C’est utile mais limité par rapport aux outils spécialisés comme Ahrefs ou Semrush. Cependant, les données dans GSC proviennent directement de Google et représentent ce que Google voit réellement—pas ce que les outils tiers estiment. Un cabinet de conseil en technologie a utilisé le rapport des liens de GSC pour découvrir que 40% de leurs backlinks utilisaient le texte d’ancrage « cabinet de conseil », ce qui est générique. Ils ont contacté les sites les plus liant et ont demandé des variations du texte d’ancrage pour inclure leurs mots-clés de service. En deux mois, leurs ancres de marque ont augmenté, et leur classement pour les mots-clés de service non marqués s’est amélioré. GSC te montre aussi laquelle de tes pages internes Google considère comme la plus importante en fonction du nombre de liens internes—cela est utile pour comprendre votre architecture de site du point de vue de Google. L’analysé des liens internes informe la stratégie de contenu et les décisions éditoriales. Tu peux identifier les pages que Google valorise fortement et t’assurer qu’elles sont optimisées de façon appropriée.

Corriger les problèmes d’exploration et surveiller la santé

Au-delà des rapports principaux, GSC dispose de plusieurs outils de diagnostic. L’inspection d’URL te permet de vérifier une page spécifique pour voir comment Google la voit, quelle version a été explorée en dernier, si elle est indexée, et quels problèmes d’utilisabilité mobile elle a. C’est incroyablement précieux pour le dépannage. Une entreprise de médias a enquêté sur la raison pour laquelle un article devenu viral n’était pas indexé et a découvert que Google ne pouvait pas rendre correctement le contenu JavaScript—le titre de l’article était chargé via JavaScript. L’ajout du rendu côté serveur a résolu le problème. Le rapport de sitemap te montre le sitemap que tu as soumis, quand Google l’a exploré en dernier, et s’il y a des problèmes. Le rapport d’utilisabilité mobile met en évidence les problèmes spécifiques au mobile comme le texte trop petit pour être lu, les éléments cliquables trop proches l’un de l’autre, et les problèmes de configuration de la fenêtre d’affichage. Une entreprise de vente au détail a découvert que ses pages de produits avaient des boutons trop proches l’un de l’autre sur mobile, ce qui rendait difficile d’appuyer sur le bouton correct. La correction de l’espacement a amélioré à la fois l’utilisabilité mobile et le taux de conversion mobile. Ces outils de diagnostic identifient les problèmes qui seraient autrement invisibles, et ils économisent d’innombrables heures de débogage.

Filtres avancés et rapports personnalisés

Le rapport de performance de GSC dispose de puissantes capacités de filtrage que la plupart des gens ne vont jamais utiliser. Tu peux filtrer par requête, page, appareil, pays, type d’apparence de recherche, et plage de dates. Combine les filtres pour répondre à des questions spécifiques : Quel est mon CTR pour les recherches mobiles ? Quelle est ma position moyenne pour les requêtes contenant « acheter » ? Quelles pages obtiennent le plus d’impressions mais le plus faible CTR ? Ces questions révèlent des opportunités d’optimisation. Une entreprise de services financiers a filtré pour les requêtes contenant « meilleur » et a découvert qu’elle se classait bien pour ces mots-clés de haute intention mais avait un CTR de 3%—très faible pour les recherches commerciales. L’amélioration de leurs balises de titre et extraits pour inclure des signaux de confiance a augmenté le CTR à 8%. Une entreprise de logiciels a filtré par pays et a découvert un trafic inattendu de régions non ciblées. Ils ont ajouté le ciblage régional à leurs campagnes et ont amélioré la pertinence pour leurs marchés principaux. Les rapports personnalisés basés sur les filtres découvrent les motifs que les concurrents manquent entièrement. La capacité à segmenter tes données par plusieurs dimensions simultanément te donne des aperçus que les données agrégées ne peuvent pas fournir.

Intégrer GSC avec Google Analytics

Une caractéristique souvent négligée dans GSC est sa liaison avec Google Analytics. Une fois connectée, tu peux voir comment ton trafic de recherche organique se comporte dans Analytics et le corréler avec les indicateurs de performance de GSC. Tu peux voir non seulement le trafic, mais aussi les métriques d’engagement comme le taux de rebond, les pages par session, et le taux de conversion pour ton trafic organique. Une entreprise SaaS a connecté GSC à GA4 et a découvert que tandis que son trafic organique augmentait (15% mois après mois), son taux de conversion baissait. En analysant les données, ils ont découvert que le nouveau trafic provenait principalement de requêtes basées sur des questions (requêtes « comment » et « qu’est-ce que »), qui avaient tendance à avoir de hauts taux de rebond. Ils ont créé du contenu de style FAQ pour ces requêtes et le taux de conversion s’est stabilisé. Tu peux aussi configurer GSC pour soumettre automatiquement des sitemaps et notifier Google des changements—bien que ce soit optionnel car Google explorera ton sitemap de toute façon. La connexion entre GSC et Analytics te donne une visibilité complète dans le parcours client et la qualité du trafic que tu reçois.

Identifier les pages qui perdent du trafic

Une application puissante de GSC est l’identification des pages qui ont perdu des classements et du trafic. Filtre le rapport de performance par plage de dates, en comparant les 90 derniers jours aux 90 jours précédents. Trie par clics et cherche les pages qui avaient auparavant des clics mais qui n’en ont maintenant zéro. Une entreprise d’édition a découvert qu’une page de pilier auparavant à haut trafic avait baissé de 500 clics mensuels à 5. À l’investigation, ils ont découvert que Google avait réindexé la page en raison d’un problème de canonicalisation introduit lors d’une migration de site. L’ancienne balise canonique pointait vers une version qui était redirigée. Le retrait de la redirection et la correction de la balise canonique ont rétabli la visibilité de la page. Un autre cas : la page de service principal d’une entreprise locale était tombée de la position 3 à la position 18. En utilisant le filtrage de plage de dates de GSC, ils ont découvert que la baisse coïncidait avec une refonte du site. La refonte avait accidentellement supprimé le balisage schéma que Google utilisait pour comprendre le sujet de la page. L’ajout du schéma a rétabli les classements de la page. La récupération du trafic est possible quand tu identifies la cause systématiquement.

Utiliser les données de GSC pour la planification de contenu stratégique

Les données de performance de GSC devraient informer directement ta stratégie de contenu. Plutôt que de te fier uniquement à l’intuition ou à la recherche de concurrents seule, utilise tes données de performance réelles pour guider la sélection des sujets. Quand tu identifies des requêtes avec beaucoup d’impressions mais un faible CTR, cela signifie que ton contenu existe dans l’index de Google pour ce sujet, mais ton extrait n’est pas assez convaincant pour attirer les clics. C’est un signal de priorisation : ces pages méritent une attention immédiate. Un site de voyage a utilisé cette approche pour identifier qu’ils se classaient pour « meilleures plages en Thaïlande » avec 800 impressions mensuelles mais seulement 2% CTR. En réécrivant leur description méta pour être plus convaincante et en mettant à jour leur balise de titre pour inclure un mot puissant, ils ont augmenté le CTR à 6% en trois semaines—320 clics mensuels supplémentaires pour zéro nouveau travail de classement. Une autre application : suivre quels sujets génèrent le plus d’impressions au fil du temps. Les sujets qui apparaissent régulièrement dans tes meilleures requêtes sont des sujets de haute valeur qui méritent un traitement de page pilier ou une couverture étendue. Une entreprise SaaS a découvert que « comparaison d’outils SEO » générait plus d’impressions que tout autre sujet de requête, donc ils ont investi dans un guide de comparaison complet qui se classe maintenant dans le top 3 pour ce terme.

De plus, GSC te révèle ce que ton site n’est PAS classé pour. Si tu as une catégorie de produits ou une zone de service qui reçoit zéro impressions, cela signifie que Google n’a pas associé ton contenu à ces requêtes. C’est ici que l’analysé des lacunes intervient—tu peux cibler des mots-clés avec une intention commerciale que les concurrents possèdent. Une entreprise de services financiers a découvert qu’elle avait zéro impressions pour « meilleures plateformes d’investissement pour les débutants », un mot-clé avec 15 000 recherches mensuelles. Ils ont créé du contenu spécifiquement pour cette requête et ont capturé 800 clics mensuels en deux mois. GSC ne te dit pas quels mots-clés cibler (les outils comme Semrush font ça), mais il te dit quels mots-clés prioriser pour ton contenu existant et où se trouvent les lacunes dans ta couverture.

Éviter les erreurs courantes de GSC

Plusieurs erreurs courantes empêchent les équipes de tirer de la valeur de GSC. D’abord, dépendre seulement des vues filtrées sans comprendre les tendances agrégées. Oui, le filtrage est puissant, mais parfois tu as besoin de voir la performance complète de ton site pour comprendre les tendances macro. Une entreprise B2B a passé des mois à optimiser des requêtes et des pages spécifiques mais a manqué que leur CTR organique global diminuait en raison d’un problème d’extrait au niveau du site affectant 30% de leurs impressions. Ils auraient dû d’abord examiner les tendances de CTR agrégées. Deuxièmement, confondre corrélation et causalité. GSC te montre les données, pas la causalité. Si tes impressions baissent après une mise à jour du site, GSC te montre la corrélation, mais tu as besoin d’une analysé manuelle pour comprendre ce qui a changé et pourquoi. Ne suppose pas que la mise à jour a causé la baisse—enquête systématiquement. Troisièmement, ignorer le rapport de couverture d’index. De nombreuses équipes célèbrent quand le nombre de leurs pages indexées augmente mais n’enquêtent pas sur les chutes soudaines ou les pics d’erreur. Un site d’actualités n’a pas remarqué quand leurs pages d’erreur sont passées de 50 à 2 000 en raison d’une malfonction d’un script de migration du site. Au moment où ils l’ont découvert, ils avaient perdu deux semaines d’indexation. Enfin, ne pas agir sur les données. GSC te donne des aperçus, mais les aperçus sans action sont inutiles. Établis un processus : examiné GSC chaque semaine, identifier les meilleures opportunités, les assigner à ton équipe, et suivre les résultats. Sans cette discipline, tu fais juste regarder des graphiques.

Maintenance et cadence de surveillance de GSC

GSC devrait être consultée chaque semaine, pas chaque mois. Configure une routine : lundi matin, passe 15 minutes à examiner le rapport de performance de la semaine précédente. Cherche les chutes inhabituelles de clics ou d’impressions, les nouvelles requêtes très performantes, et les pages en positions 11-20 (tes fruits à portée de main pour l’optimisation). Vérifie le rapport de couverture d’index pour les nouvelles erreurs mensuellement—une augmentation soudaine des erreurs indique souvent un problème technique. Surveille les Core Web Vitals mensuellement et agis sur les pages avec de mauvais scores. Une agence de contenu a fait de l’examen de GSC une partie de sa réunion éditoriale hebdomadaire, montrant à l’équipe quels sujets génèrent du trafic. Cela leur a donné un aperçu basé sur les données de ce que l’audience veut réellement, améliorant significativement la stratégie de contenu. Une dernière note : les données de GSC ont un délai de 2-3 jours, donc les performances du jour actuel ne sont pas visibles. Vérifie toujours les données historiques lors de l’investigation des problèmes. Ne t’attends pas à des données en temps réel—au lieu de cela, établis une habitude d’examen cohérente chaque semaine. La constance s’agrandit avec le temps et prévient les petits problèmes de devenir de grands.

Conclusion : du SEO réactif au SEO proactif

Google Search Console transforme ton SEO du dépannage réactif à l’optimisation proactive. Au lieu d’attendre que le trafic baisse pour enquêter, tu peux voir les problèmes à venir dans le rapport de couverture d’index, identifier le contenu sous-performant dans le rapport de performance, et améliorer les Core Web Vitals avant qu’ils n’impactent les classements. L’outil te donne la perspective de Google sur ton site—ce qu’il voit, ce qu’il peut explorer, comment il interprète ton contenu. Aucun autre outil ne fournit cette perspective directement. Traite GSC comme ton tableau de bord de monitoring principal et GA4 comme ton outil d’analysé de comportement. Ensemble, ils te donnent une visibilité complète sur ta performance de recherche organique. Fais de GSC une partie de ton rituel hebdomadaire, et tu trouveras des opportunités que les concurrents SEO manquent entièrement. Les sites qui dominent leurs marchés comprennent complètement leurs données—et GSC est la fondation de cette compréhension. Chaque succès SEO significatif commence par un monitoring de GSC cohérent. Commence aujourd’hui, établis l’habitude immédiatement, et regarde ta visibilité organique se transformer au cours des prochains mois.